算力破局:大模型训练与微调的硬件架构之道

时间:2026-03-27 14:05:03

来源:UltraLAB图形工作站方案网站

人气:68

作者:admin

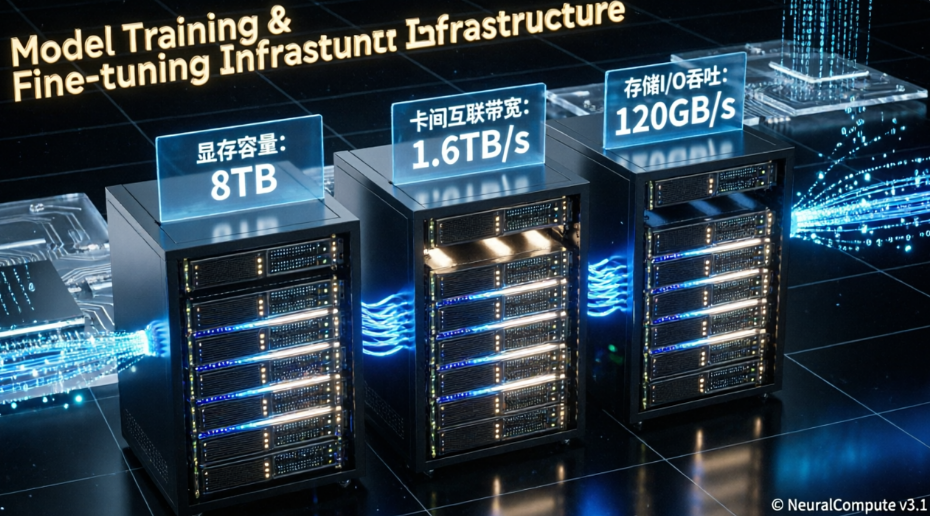

当模型参数突破千亿、训练数据迈向万亿Token,大模型研发已从“算法创新”全面转向“系统工程”——计算集群的显存容量、卡间互联带宽、存储I/O吞吐,每一项都直接决定从实验到落地的周期。本文深度解构大模型训练与微调的计算特征,并提供与之匹配的UltraLAB硬件方案。

大模型训练与微调已成为人工智能领域最核心的工程实践。无论是百亿参数的基座模型预训练,还是面向特定场景的指令微调(SFT)、人类偏好对齐(RLHF),其本质都是在大规模并行计算架构上,对海量数据进行梯度迭代。这一过程对硬件的严苛要求,已远超传统科研计算范畴,形成了一套独特的技术体系。

一、大模型计算特征与硬件瓶颈

1. 多卡并行:从数据并行到多维混合

现代大模型训练普遍采用三维并行策略:

-

数据并行:每个GPU持有完整模型副本,处理不同数据分片

-

张量并行:将单个Transformer层切分至多卡,解决单卡显存无法容纳完整模型的问题

-

流水线并行:将模型按层切分为多个Stage,多卡流水执行

硬件要求:

-

卡间通信带宽决定并行效率,NVLink(≥900GB/s)优于PCIe(128GB/s)

-

多卡需支持统一显存池架构,避免跨卡通信成为瓶颈

2. 显存容量:决定“能训多大模型”的硬约束

大模型训练中显存消耗主要包括:

-

模型参数:BF16下,70B模型约140GB

-

优化器状态:Adam优化器需存储参数、梯度、一阶矩、二阶矩(4倍参数量),即560GB

-

激活值:批量训练时,中间激活占用可达参数量的2-3倍

-

临时缓冲:梯度累加、通信缓冲等额外开销

硬件要求:

-

单卡显存需≥80GB(如H100)方可承载70B级模型的完整训练

-

若采用LoRA等参数高效微调,显存需求可降至40GB以内,但仍需多卡并行加速

3. 混合精度训练:算力与精度的平衡

现代训练采用混合精度策略:

-

FP8/BF16:用于前向与反向传播,降低显存占用,提升计算吞吐

-

FP32:优化器状态与梯度累加保留高精度,保障收敛

硬件要求:

-

GPU需原生支持FP8/BF16硬件加速(如NVIDIA H100/RTX 5090)

-

理论算力在低精度下可达FP32的4-8倍

4. 数据加载与Checkpoint I/O

-

训练数据:万亿Token级数据集需高速随机读取

-

Checkpoint保存:每数小时保存一次模型状态,单次写入达百GB

-

日志与监控:训练过程中持续记录指标,对存储带宽亦有要求

硬件要求:

-

全闪存阵列(NVMe SSD)提供≥10GB/s读取带宽

-

RAID0或分布式存储保障Checkpoint写入不阻塞训练

二、UltraLAB大模型训练与微调硬件方案

方案A:70B-700B级基座模型预训练

适用场景:千亿参数基座模型从头训练、大规模RLHF数据采集

技术亮点:

-

支持Megatron-LM + DeepSpeed的三维并行策略

-

内置NVSwitch,跨卡All-Reduce延迟μs

-

液冷散热保障8卡持续满功耗(约5600W)稳定运行

方案B:7B-70B级模型微调与RLHF

适用场景:基座模型指令微调(SFT)、人类反馈强化学习(RLHF)、LoRA/QLoRA高效微调

技术亮点:

-

支持vLLM/TGI与训练框架混合部署,实现微调与推理同节点协同

-

配置LlamaFactory等高效微调框架的预优化环境

方案C:单卡大模型推理与开发验证

适用场景:模型快速原型验证、7B-13B模型本地推理、LoRA适配器实验

技术亮点:

-

预装vLLM推理引擎,实现FP8推理加速

-

支持TensorRT-LLM优化,提升生成吞吐

三、关键优化技术

1. 显存优化:突破单卡容量极限

-

FlashAttention-3:通过分块计算与重计算,将注意力机制显存占用降低5-10倍

-

ZeRO(Zero Redundancy Optimizer):将优化器状态、梯度、参数分片存储于多卡,实现显存线性扩展

-

梯度检查点:以时间换空间,激活值显存占用可降至原来的1/10

2. 通信优化:提升多卡并行效率

-

NVLink + NVSwitch:单节点内8卡全互联,带宽900GB/s,显著优于PCIe

-

梯度融合:将小梯度合并传输,减少通信次数

-

计算-通信重叠:在反向传播中异步执行梯度同步,隐藏通信延迟

3. 存储优化:消除I/O瓶颈

-

数据预处理流水线:CPU异步加载、Tokenization与GPU训练并行

-

Checkpoint异步保存:后台写入磁盘,不阻塞训练迭代

-

内存文件系统(tmpfs):将高频访问的小数据集驻留内存

四、结语:算力是大模型的“第二语言”

大模型从实验室走向产业应用,依赖的是算法、数据与算力的三位一体。当模型参数突破千亿、训练数据迈向万亿Token,算力基础设施的精准配置已不再是“后勤保障”,而是直接决定技术路线的可行性边界。

UltraLAB基于对大模型计算特征的深度理解,提供从个人验证到千卡集群的全系列硬件方案。每一台工作站的配置逻辑,都源自对显存容量、卡间互联、存储I/O三大瓶颈的系统性突破——让研究者专注于模型架构与算法创新,而非底层算力适配的复杂性。

如需针对具体模型规模(如7B/70B/700B)与训练策略(全参数微调/LoRA/RLHF)的定制化配置,欢迎联系UltraLAB技术顾问团队。

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

咨询微信号:

上一篇:没有了

下一篇:没有了